大模型知识库系统可以实现知识、信息的准确检索与回答。原理是将大规模的文本数据进行预训练,通过深度学习算法将语义和上下文信息编码到模型的参数中。当用户提出问题时,模型会根据问题的语义和上下文信息,从知识库中找到相关的信息进行回答。大模型知识库的检索功能应用广阔,例如在搜索引擎中,可以为用户提供更加准确...

- 品牌

- 音视贝

- 型号

- DMX

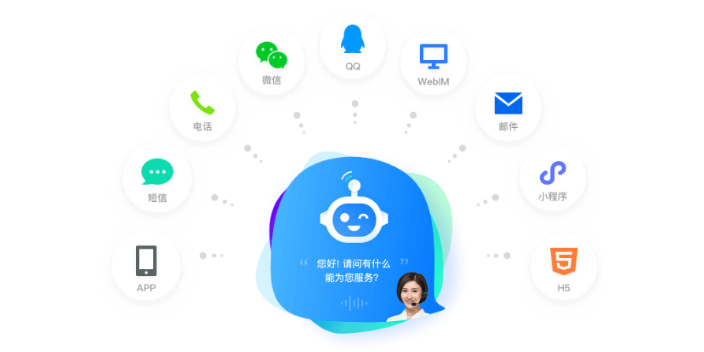

对商家而言,大模型切合实际的应用场景莫过于电商行业。首先是客服领域。随着电商行业发展,消费者对服务质量的要求日益提高,客服的作用也越来越突出。商家为了节约经营成本,会采用人机结合的模式,先用智能客服回答一部分简单的问题,机器人解决不了的再靠人工客服解决。想法是好的,但目前各大平台的智能客服往往只能根据关键词给出预设好的答案,无法真正理解消费者的问题,人工客服的压力依然很大。其次是营销获客领域。直播带货的普及让“人找货”变成了“货找人”。平台利用大模型的人工智能算法实现海量数据集的深度学习,分析消费者的行为,预测哪些产品可能会吸引消费者点击购买,从而为他们推荐商品。这种精细营销,一方面平台高效利用流量,另一方面,也降低了消费者的选择成本。大模型的长处在于能够找到新的解法,帮助解决新问题,解决以后可以在狭窄领域产生大量数据,训练小模型。江苏垂直大模型发展前景是什么

随着机器学习与深度学习技术的不断发展,大模型的重要性逐渐得到认可。大模型也逐渐在各个领域取得突破性进展,那么企业在选择大模型时需要注意哪些问题呢?

1、任务需求:确保选择的大模型与您的任务需求相匹配。不同的大模型在不同的领域和任务上有不同的优势和局限性。例如,某些模型可能更适合处理自然语言处理任务,而其他模型可能更适合计算机视觉任务。

2、计算资源:大模型通常需要较大的计算资源来进行训练和推理。确保您有足够的计算资源来支持所选模型的训练和应用。这可能涉及到使用高性能的GPU或TPU,以及具备足够的存储和内存。

3、数据集大小:大模型通常需要大量的数据进行训练,以获得更好的性能。确保您有足够的数据集来支持您选择的模型。如果数据量不足,您可能需要考虑采用迁移学习或数据增强等技术来提高性能。 福州中小企业大模型发展前景是什么国内的一些投资人和创业者,在经过几个月的折腾后,发现还是要寻找盈利模式,业务应用场景和商业化的能力。

“大模型+领域知识”这一路线,是为了利用大模型的理解能力,将散落在企业内外部各类数据源中的事实知识和流程知识提取出来,然后再利用大模型的生成能力输出长文本或多轮对话。以前用判别式的模型解决意图识别问题需要做大量的人工标注工作,对新领域的业务解决能力非常弱,有了这类大模型以后,通过微调领域prompt,利用大模型的上下文学习能力,就能很快地适配到新领域的业务问题,其降低对数据标注的依赖和模型定制化成本。

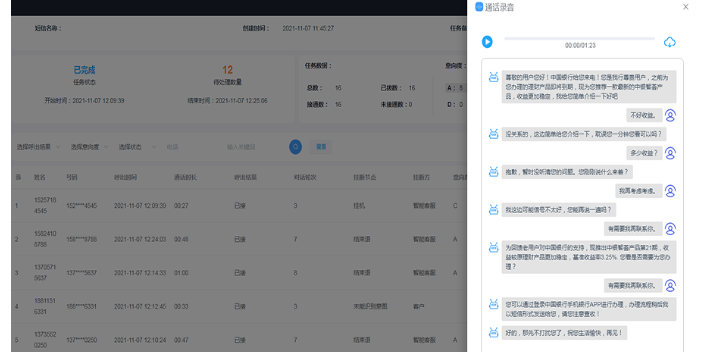

杭州音视贝科技公司的智能外呼、智能客服、智能质检等产品通过自研的对话引擎,拥抱大模型,充分挖掘企业各类对话场景数据价值,帮助企业实现更加智能的沟通、成本更低的运营维护。

国内比较出名大模型主要有:

1、ERNIE(EnhancedRepresentationthroughkNowledgeIntEgration):ERNIE是由百度开发的一个基于Transformer结构的预训练语言模型。ERNIE在自然语言处理任务中取得了较好的性能,包括情感分析、文本分类、命名实体识别等。

2、HANLP(HanLanguageProcessing):HANLP是由中国人民大学开发的一个中文自然语言处理工具包,其中包含了一些中文大模型。例如,HANLP中的大模型包括中文分词模型、词法分析模型、命名实体识别模型等。

3、DeBERTa(Decoding-enhancedBERTwithdisentangledattention):DeBERTa是由华为开发的一个基于Transformer结构的预训练语言模型。DeBERTa可以同时学习局部关联和全局关联,提高了模型的表示能力和上下文理解能力。

4、THUNLP(TsinghuaUniversityNaturalLanguageProcessingGroup):清华大学自然语言处理组(THUNLP)开发了一些中文大模型。其中的大模型包括中文分词模型、命名实体识别模型、依存句法分析模型等。

5、XiaoIce(小冰):XiaoIce是微软亚洲研究院开发的一个聊天机器人,拥有大型的对话系统模型。XiaoIce具备闲聊、情感交流等能力,并在中文语境下表现出很高的流畅性和语言理解能力。 大模型的训练过程复杂、成本高,主要是由于庞大的参数量、大规模的训练数据需求等因素的共同作用。

目前市面上有许多出名的AI大模型,其中一些是:

1、GPT-3(GenerativePre-trainedTransformer3):GPT-3是由OpenAI开发的一款自然语言处理(NLP)模型,拥有1750亿个参数。它可以生成高质量的文本、回答问题、进行对话等。GPT-3可以用于自动摘要、语义搜索、语言翻译等任务。

2、BERT(BidirectionalEncoderRepresentationsfromTransformers):BERT是由Google开发的一款基于Transformer结构的预训练语言模型。BERT拥有1亿个参数。它在自然语言处理任务中取得了巨大的成功,包括文本分类、命名实体识别、句子关系判断等。

3、ResNet(ResidualNetwork):ResNet是由Microsoft开发的一种深度卷积神经网络结构,被用于计算机视觉任务中。ResNet深层网络结构解决了梯度消失的问题,使得训练更深的网络变得可行。ResNet在图像分类、目标检测和图像分割等任务上取得了***的性能。

4、VGGNet(VisualGeometryGroupNetwork):VGGNet是由牛津大学的VisualGeometryGroup开发的卷积神经网络结构。VGGNet结构简单清晰,以其较小的卷积核和深层的堆叠吸引了很多关注。VGGNet在图像识别和图像分类等任务上表现出色

。5、Transformer:Transformer是一种基于自注意力机制的神经网络结构。 智能客服作为人工智能技术的应用之一,已经取得了很大的成就,具有巨大的发展潜力。江苏人工智能大模型使用技术是什么

大模型可以给机器人发命令、理解机器人的反馈、分解任务变成动作、帮助机器处理图像、声音等多模态的数据。江苏垂直大模型发展前景是什么

优化大型知识库系统需要综合考虑数据库存储、系统架构、缓存机制等多个方面,还需要考虑任务队列设计,搜索与算法,定期进行压力测试,建立监控系统等,通过合理的设计和技术手段,提高系统的性能、稳定性和用户体验。下面我们就来详细说一说。

首先,对于一些处理耗时较长的任务,如数据导入、索引更新等,可以采用异步处理和任务队列技术,将任务提交到队列中,由后台异步处理,以避免前台请求的阻塞和延迟。

其次,针对知识库系统的搜索功能,可以优化搜索算法和索引结构,如使用倒排索引、词频统计等技术,提高搜索结果的准确性和响应速度。同时,可以根据用户的搜索历史和行为,个性化推荐相关的知识内容。

然后,压力测试和性能监控:进行定期的压力测试,模拟真实的并发情况,评估系统的性能和稳定性。同时,建立性能监控系统,实时监测系统的各项指标,如响应时间、吞吐量、资源利用率等,及时发现和解决潜在的性能问题。 江苏垂直大模型发展前景是什么

- 深圳垂直大模型使用技术是什么 2026-03-22

- 福州AI大模型是什么 2026-03-21

- 大模型技术研讨会 2026-03-21

- 广东人工智能大模型的概念是什么 2026-03-21

- 广州垂直大模型使用技术是什么 2026-03-20

- 福建通用大模型的概念是什么 2026-03-20

- 深圳中小企业大模型特点是什么 2026-03-20

- 福建深度学习大模型应用场景有哪些 2026-03-20

- 浙江人工智能大模型推荐 2026-03-18

- 上海垂直大模型如何落地 2026-03-18

- 深圳中小企业大模型怎么应用 2026-03-18

- 宁波营销大模型平台 2026-03-16

-

天津物业大模型定制 2026-03-15 05:02:02在人工智能领域,人形机器人与大模型是当下的行业热点,它们以不同的方式改变着我们的生活和工作,推动经济发展,同时也在重塑服务业的运营模式。人形机器人以其高度仿真的外观和强大的功能,正在渗透到各个服务行业之中。在餐饮、旅游、医疗等领域,人形机器人能够提供更加高效和人性化的服务。例如,在日本的一些餐厅中,...

-

杭州物业大模型商家 2026-03-14 18:01:41尽管大模型具备多种优势,但在落地应用过程中,对于软硬件设备、安全性、技术开发能力等方面仍有着较高的要求。比如,对于计算资源的需求、数据安全性保障等问题都需要企业投入大量的资源和时间进行解决。此外,大模型的应用还需要企业具备较强的技术开发能力,能够根据业务需求进行模型开发和优化,以提高模型的准确性...

-

重庆教育大模型费用 2026-03-14 07:02:14本地知识库通常包含一个结构化的数据库,里面存储了各种类型的知识,运用大模型构建本地知识库,原理是将预训练的语言模型与知识图谱相结合,将输入的自然语言问题转化为对知识库的查询问题,并利用知识图谱中的实体、属性和关系进行推理。 在智能办公与文档管理方面,大模型本地知识库可强化知识检索、知识推送...

-

山东医疗大模型产品介绍 2026-03-14 21:02:14搭建一套属于自己的知识库系统都有哪些步骤呢? 1、明确具体需求和目标。考虑如何组织知识内容,系统的使用受众是谁,需要哪些功能模块,用户权限如何设置等; 2、选择平台和工具。平台可以考虑使用开源的平台,工具选择一个功能齐全,操作简便且符合前面一条需求和目标的系统 ;3、设置知识库...